هوش مصنوعی دوستانه - ویکیپدیا، دانشنامهٔ آزاد

| بخشی از مقالهها درباره |

| هوش مصنوعی |

|---|

|

هوش مصنوعی دوستانه (همچنین AI دوستانه یا FAI) یک هوش جامع مصنوعی فرضی (AGI) است که تاثیر مثبتی بر بشریت خواهد داشت. این بخشی از اخلاق هوش مصنوعی است و ارتباط نزدیکی با اخلاق ماشینی دارد. در حالی که اخلاق ماشینی به چگونگی رفتار یک عامل هوشمند مربوط است،تحقیقات هوش مصنوعی دوستانه بر چگونگی استفاده عملی از این رفتار و تضمین محدودیت آن به اندازه کافی متمرکز است.

ریشه شناسی و کاربرد[ویرایش]

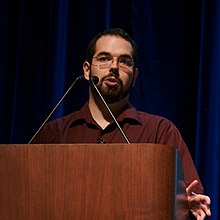

این اصطلاح توسط الیزر یودکوفسکی،[۱] که بیش تر به دلیل محبوبیت بخشیدن به این ایده معروف است،[۲][۳] برای بحث در مورد عوامل مصنوعی فراهوش که به صورت قابل اعتمادی ارزش های انسانی را پیاده سازی می کنند، ابداع شد. استوارت ج. راسل و پیتر نورویگ، در کتاب مشهور خود (هوش مصنوعی؛ رویکردی نوین) این ایده را توضیح می دهند:[۴]

یودکوفسکی (۲۰۰۸) جزئیات بیش تری در رابطه با طراحی هوش مصنوعی دوستانه ارائه می دهد. او ادعا می کند که دوستی (عدم تمایل به آسیب رساندن به انسان ها، باید از همان ابتدای امر طراحی بشود، اما طراحان باید این را هم در نظر بگیرند که هم ممکن است طرح های آن ها دارای نقص باشد و هم ربات در طول زمان فراخواهد گرفت و تکامل پیدا خواهد کرد. بنابراین، چالش، یکی از طراحی های این مکانیزم است - تعریف مکانیزمی برای تکامل سیستم های هوش مصنوعی تحت یک سیستم کنترل و تعادل و دادن توابع سودمندی به سیستم تا آن را در برابر این تغییرات دوستانه نگه دارد.

واژه 'دوستانه' در این زمینه، یک اصطلاح فنی است و این منظور را می رساند که که عامل هوشمند، امن و مفید است و لزوماً به معنای محاوره ای آن نیست. این مفهوم اساساً در چارچوب مباحث مربوط به عوامل مصنوعی بازگشتی خود بهبود دهنده که به سرعت در حال پیشرفت هستند، مورد استناد قرار می گیرد، به این دلیل که این فناوری فرضی تأثیر گسترده، سریع و کنترل ناپذیری بر جامعه بشری خواهد داشت.[۵]

خطرات هوش مصنوعی غیر دوستانه(Unfriendly AI)[ویرایش]

نگرانی درباره هوش مصنوعی قدمتی طولانی دارد. کوین لاگراندور می گوید که مخاطرات هوش مصنوعی را می توان در ادبیات کهن دید. او در این باره، داستان های خدمتگذاران مصنوعی انسان نما همچون گولم یا ربات های اولیه از گربرت اوریلاک و راجر بیکن را مثال می زند. در این داستان ها، هوش و قدرت بی اندازه این مخلوقات انسان نما با جایگاه آن ها به عنوان برده دچار تضاد و باعث به وجود آمدن مشکلاتی شد.[۶] در سال ۱۹۴۲، این پیش زمینه ها باعث شد تا ایزاک آسیموف "قوانین سه گانه رباتیک" که بسیار سختگیرانه بودند را در داستان هایش به کار گیرد تا از ایجاد آسیب توسط آن ها و یا آشوب علیه خالقشان جلوگیری کند.[۷]

در زمان معاصر با نزدیک شدن چشم انداز هوش مصنوعی فراهوش، نیک باسترومِ فیلسوف گفته است که سیستم های هوش مصنوعی فوق هوشمند با اهدافی که با اخلاق انسانی همسو نیستند، ذاتاً خطرناک هستند، مگر اینکه اقدامات شدیدی برای اطمینان از ایمنی بشریت انجام شود. او اینگونه بیان می کند:

اساساً باید فرض کنیم که یک "فراهوش" می تواند به هر هدفی که دارد برسد. بنابراین، بسیار مهم است که اهدافی که ما برای آن ها تعیین می کنیم و کل سیستم انگیزه آن، "انسان دوستانه" باشد.

در سال ۲۰۰۸، الیزر یودکوفسکی، خواستار ایجاد هوش مصنوعی دوستانه در راستای کاهش مخاطرات موجود ناشی از هوش مصنوعی پیشرفته شد. او می گوید: "هوش مصنوعی نه از شما متنفر است و نه شما را دوست دارد؛ اما شما از اتم هایی ساخته شده اید که او می تواند از آن ها به منظور دیگری استفاده کند."[۸]

استیو اوموهوندرو می گوید، به دلیل ماهیت ذاتی هر سیستم هدفمند، یک سیستم هوش مصنوعی کاملاً پیشرفته، مگر اینکه کنترل شود، تعدادی "درایو" اساسی مانند دستیابی به منابع ، حفظ خود و خودسازی مداوم را به نمایش می گذارد. و اینکه این درایوها "بدون اقدامات احتیاطی خاص" باعث می شوند هوش مصنوعی رفتار نامطلوبی از خود نشان دهد.[۹][۱۰]

لكساندر ویسنر-گروس می گوید، هوش مصنوعی که برای به حداکثر رساندن آزادی عمل در آینده هدایت می شود، اگر افق برنامه ریزی آنها بیش از آستانه خاصی باشد،دوستانه و اگر افق برنامه ریزی آنها از این آستانه کوتاه تر باشد، غیر دوستانه تلقی می شود.[۱۱][۱۲]

لوک موهولهاوزر، که در مؤسسه تحقيقات هوش ماشينينوسینده است، توصیه می کند محققان در زمینه اخلاق ماشيني آنچه را که بروس اشنایر "ذهنیت امنیتی" خوانده است، بپذیرند: به جای اینکه به چگونگی کارکرد یک سیستم فکر کنید، تصور کنید که چگونه ممکن است از کار بیفتد. به عنوان مثال، او می گوید حتی هوش مصنوعی که فقط پیش بینی های دقیق را انجام می دهد و از طریق رابطِ متنی ارتباط برقرار می کند، ممکن است آسیب ناخواسته ای ایجاد کند.[۱۳]

در سال 2014 ، لوک موهولهاوزر و نیک بوستروم بر نیاز به "هوش مصنوعی دوستانه" تأکید کردند.[۱۴] با این وجود، مشکلات قابل توجهی در طراحی فراهوشمندی "دوستانه"، به عنوان مثال از طریق برنامه ریزی تفکر اخلاقی ضد واقعیت، وجود دارد.[۱۵][۱۶]

اراده منسجم برون یابی شده[ویرایش]

یودکوفسکی مدل اراده منسجم برون یابی شده(CEV) را پیشرفت می دهد. به گفته وی، اراده منسجم برون یابی شده، انتخاب ها و اعمالی از مردم است که در صورتی که می توانستند "بیش تر و سریع تر کسب علم کنند و بیش تر به شخصیتی که می خواستند نزدیک تر بودند" به آن روی می آوردند.[۱۷]

به جای اینکه یک AI دوستانه به طور مستقیم توسط برنامه نویسان انسانی طراحی شود، باید توسط "هوش مصنوعی هسته ای" برنامه ریزی شود که ابتدا طبیعت انسان را مطالعه کند و سپس هوش مصنوعی ای را تولید کند که بشریت می خواهد با توجه به زمان و بینش کافی، به یک نتیجه مطلوب برسد.[۱۷] توسل به یک هدف از طریق طبیعت مشروط انسانی به عنوان معیار "دوستانه بودن"، جوابی برای مشکل فرااخلاقی بودن تعریف اخلاقیت عینی است. اراده منسجم برون یابی شده در نظر گرفته شده همان چیزی است که بشریت به طور عینی می خواهد ، همه مواردی که در نظر گرفته می شود ، اما فقط در رابطه با ویژگی های روانشناختی و شناختی بشریت فعلی و خارج برون رفت قابل تعریف است.

رویکردهای دیگر[ویرایش]

استیو اوموهوندرو رویکرد "داربست" را برای ایمنی هوش مصنوعی پیشنهاد کرده است ، که در آن یک نسل ایمن سازی هوش مصنوعی قابل اثبات به ساخت نسل بعدی ایمن کمک می کند.[۱۸]

ست باوم استدلال می کند که توسعه هوش مصنوعی ایمن و مفید از نظر اجتماعی یا هوش عمومی مصنوعی تابعی از روانشناسی اجتماعی جوامع تحقیقاتی هوش مصنوعی است، و بنابراین می تواند توسط اقدامات بیرونی محدود شود و با معیارهای ذاتی انگیره داده شود.انگیزه های ذاتی می توانند با طنین انداز شدن پیام های توسعه دهندگان هوش مصنوعی تقویت شوند. در مقابل، باوم استدلال می کند که "پیغام های موجود در رابطه با هوش مصنوعی سودمند همیشه به خوبی تنظیم نمیشوند". باوم طرفدار "روابط تعاونی و چارچوب مثبت محققان هوش مصنوعی" است و نسبت به دسته بندی محققان هوش مصنوعی به عنوان "عدم تمایل به دنبال طرح های مفید" هشدار می دهد.[۱۹]

در کتاب Human Compatible از باوم، استوارت.ج راسل، محقق در زمینه هوش مصنوعی، سه اصل را برای راهنمایی در جهت توسعه ماشین های سودمند تعریف می کند. او تاکید می کند که این اصول نباید صراحتاً به عنوان کد در ماشین ها استفاده شوند، بلکه این ها برای انسان ها در نظر گرفته شده اند. این اصول عبارتند از:[۲۰]:۱۷۳

- تنها هدف ماشین، حداکثر کردن تشخیص اولویت های انسان است.

- ماشین در حالت اولیه نسبت به این که آن اولویت ها چه هستند نامطمئن است.

- منبع کامل اطلاعات در رابطه با اولویت های انسان، رفتارهای اوست.

"اولویت"هایی که راسل به آن ها اشاره می کند، "شامل همه چیز هایی می شود که ممکن است برای شما مهم باشند."[۲۰] به همین ترتیب "رفتار" شامل هر انتخاب میان گزینه هاست و عدم قطعیت به حدی است،[۲۰] که هر احتمالی هر چند ناچیز، باید به اولویت های منطقاً ممکن برای انسان نسبت دهد.[۲۰]

سیاست عمومی[ویرایش]

جیمز بارات، نویسنده کتاب "اختراع نهایی ما "، اظهار داشت که "باید یک مشارکت دولتی-خصوصی ایجاد شود تا سازندگان هوش مصنوعی در آن گرد هم بیایند و ایده های خود را در مورد امنیت به اشتراک بگذارند؛ چیزی مانند آژانس بینالمللی انرژی اتمی، اما با همکاری شرکت های بزرگ." وی از محققان هوش مصنوعی می خواهد جلسه ای مشابه کنفرانس Asilomar در DNA نوترکیب تشکیل دهند، که در مورد خطرات بیوتکنولوژی صحبت می کند.[۱۸]

جان مک گینیس دولت ها را تشویق می کند تا به تحقیقات در زمینه هوش مصنوعی دوستانه سرعت بخشند. از آنجا که دروازه هدف AI دوستانه لزوماً برجسته نیست، او مدلی مشابه موسسه ملی بهداشت پیشنهاد می کند، جایی که "پانل های بررسی همتای دانشمندان رایانه ای و شناختی پروژه ها را غربال می کنند و آنهایی را انتخاب می کنند که هم برای پیشرفت AI طراحی شده اند و هم اطمینان می دهند که این پیشرفت ها با محافظ های مناسب همراه است."از نظر مک گینیس بررسی همتا از "قاعده سازی برای حل مسائل فنی که در میان فرمان های بوروکراتیک غیر قابل تسخیر هستند" بهتر است. مک گینیس خاطرنشان می کند که پیشنهاد وی برخلاف پیشنهاد موسسه تحقیقات هوش ماشین است که هدف کلی آن جلوگیری از دخالت دولت در هوش مصنوعی دوستانه است.[۲۱]

به گفته گری مارکوس، مبلغی که سالانه صرف توسعه اخلاق ماشینی می شود ناچیز است.[۲۲]

انتقاد[ویرایش]

بعضی منتقدین اعتقاد دارند که AI هم در سطح انسانی و هم در سطح فراهوش غیرمحتمل اند و در نتیجه AI دوستانه غیرمحتمل است. در نوشته ای در The Guardian، آلن وینفیلد هوش مصنوعی سطح انسانی را از نظر سختی با مسافرت سریع تر از نور مقایسه می کند و بیان می کند که اگرچه باید نسبت به مخاطرات احتمالی فراهوش آگاه باشیم اما نباید نسبت به آن وسواس به خرج دهیم.[۲۳] از طرف دیگر بویلز و خواکین استدلال می کنند که به نظر می رسد پیشنهاد لوک موهولهاوزر و نیک بوستروم برای ایجاد هوش مصنوعی دوستانه مبهم باشد. این به این دلیل است که به نظر می رسد موهولهاوزر و بوستروم عقیده دارند که می توان ماشین های هوشمند را طوری برنامه ریزی کرد که در مورد ارزشهای اخلاقی انسانها خلاف واقع فکر کنند.[۲۴] در مقاله AI & Society بویلز و خواکین اظهار کردند که با در نظر گرفتن موارد زیر، چنین هوش مصنوعی دوستانه نخواهد بود: مقدار نامحدودی از شرایط خلاف پیشینی که باید در یک ماشین برنامه ریزی شوند، دشواری تهیه پول از مجموعه ارزشهای اخلاقی - یعنی آنهایی که ایدهآل تر از آنچه در حال حاضر انسان دارد، و قطع ارتباط آشکار بین پیشینیان خلاف واقع و نتیجه ایدهآل.[۲۵]

بعضی فلاسفه مدعی اند که هر عامل عقلائی، خواه مصنوعی یا انسان، طبیعتاً خیرخواه خواهند بود. بر اساس این دیدگاه محافظینی که برای تولید هوش مصنوعی دوستانه طراحی شده اند، غیرضروری یا حتی خطرناک به حساب می آیند. [۲۶]سایر منتقدین می پرسند که آیا اصلاً برای یک هوش مصنوعی ممکن است تا دوستانه باشد؟ آدام کیپر و آری ن. شولمن، ویراستاران ژورنال The new Atlantis، می گویند که این غیر ممکن است که بتوان رفتار دوستانه در هوش مصنوعی را تضمین کرد؛ زیرا مشکلات پیچیدگی اخلاقی به پیشرفت نرمافزار یا افزایش قدرت محاسبات منجر نمیشود. آنها می نویسند که معیارهایی که نظریه های هوش مصنوعی دوستانه بر اساس آن ها کار می کنند، فقط زمانی کار می کنند که "فرد نه تنها قدرت بالایی در پیش بینی شباهت خروجی های بی شمار ممکن داتشه باشد، بلکه در مورد چگونگی ارزیابی نتایج مختلف از یقین و اتفاق نظر برخوردار باشد.[۲۷]

جستارهای وابسته[ویرایش]

- مشکل کنترل هوش مصنوعی

- تصرف هوش مصنوعی

- مسابقه تسلیحاتی هوش مصنوعی

- اخلاق هوش مصنوعی

- خطر وجودی از هوش عمومی مصنوعی

- انفجار اطلاعات

- اخلاق ماشینی

- موسسه تحقیقات هوش ماشین

- OpenAI

- تنظیم الگوریتم ها

- Singularitarianism - فلسفه اخلاقی مورد حمایت طرفداران AI Friendly

- تکینگی فنی

- سه قانون رباتیک

منابع[ویرایش]

- ↑ Tegmark, Max (2014). "Life, Our Universe and Everything". Our Mathematical Universe: My Quest for the Ultimate Nature of Reality (First ed.).

- ↑ Russell, Stuart; Norvig, Peter (2009). Artificial Intelligence: A Modern Approach. Prentice Hall. ISBN 978-0-13-604259-4.

- ↑ Leighton, Jonathan (2011). The Battle for Compassion: Ethics in an Apathetic Universe. Algora. ISBN 978-0-87586-870-7.

- ↑ Russell, Stuart; Norvig, Peter (2010). Artificial Intelligence: A Modern Approach. Prentice Hall. ISBN 978-0-13-604259-4.

- ↑ Wallach, Wendell; Allen, Colin (2009). Moral Machines: Teaching Robots Right from Wrong. Oxford University Press, Inc. ISBN 978-0-19-537404-9.

- ↑ Kevin LaGrandeur. "The Persistent Peril of the Artificial Slave". Science Fiction Studies. Retrieved 2013-05-06.

- ↑ Isaac Asimov (1964). "Introduction". The Rest of the Robots. Doubleday. ISBN 0-385-09041-2.

- ↑ Eliezer Yudkowsky (2008) in Artificial Intelligence as a Positive and Negative Factor in Global Risk

- ↑ Omohundro, S. M. (2008, February). The basic AI drives. In AGI (Vol. 171, pp. 483-492).

- ↑ Bostrom, Nick (2014). Superintelligence: Paths, Dangers, Strategies. Oxford: Oxford University Press. ISBN 9780199678112. Chapter 7: The Superintelligent Will.

- ↑ How Skynet Might Emerge From Simple Physics, io9, Published 2013-04-26.

- ↑ Wissner-Gross, A. D.; Freer, C. E. (2013). "Causal entropic forces بایگانیشده در ۱۱ ژانویه ۲۰۲۰ توسط Wayback Machine" (PDF). Physical Review Letters. 110 (16): 168702. Bibcode:2013PhRvL.110p8702W. doi:10.1103/PhysRevLett.110.168702. PMID 23679649.

- ↑ Muehlhauser, Luke (31 Jul 2013). "AI Risk and the Security Mindset". Machine Intelligence Research Institute. Retrieved 15 July 2014.

- ↑ Muehlhauser, Luke; Bostrom, Nick (2013-12-17). "Why We Need Friendly AI". Think. 13 (36): 41–47. doi:10.1017/s1477175613000316. ISSN 1477-1756.

- ↑ Boyles, Robert James M.; Joaquin, Jeremiah Joven (2019-07-23). "Why friendly AIs won't be that friendly: a friendly reply to Muehlhauser and Bostrom". AI & Society. 35 (2): 505–507. doi:10.1007/s00146-019-00903-0. ISSN 0951-5666. S2CID 198190745.

- ↑ Chan, Berman (2020-03-04). "The rise of artificial intelligence and the crisis of moral passivity". AI & Society. doi:10.1007/s00146-020-00953-9. ISSN 1435-5655. S2CID 212407078.

- ↑ ۱۷٫۰ ۱۷٫۱ "Coherent Extrapolated Volition" (PDF). Intelligence.org. Retrieved 2015-09-12.

- ↑ ۱۸٫۰ ۱۸٫۱ Hendry, Erica R. (21 Jan 2014). "What Happens When Artificial Intelligence Turns On Us?". Smithsonian.com. Retrieved 15 July 2014.

- ↑ Baum, Seth D. (2016-09-28). "On the promotion of safe and socially beneficial artificial intelligence". AI & Society. 32 (4): 543–551. doi:10.1007/s00146-016-0677-0. ISSN 0951-5666. S2CID 29012168.

- ↑ ۲۰٫۰ ۲۰٫۱ ۲۰٫۲ ۲۰٫۳ Russell, Stuart (October 8, 2019). Human Compatible: Artificial Intelligence and the Problem of Control. United States: Viking. ISBN 978-0-525-55861-3. OCLC 1083694322.

- ↑ McGinnis, John O. (Summer 2010). "Accelerating AI". Northwestern University Law Review. 104 (3): 1253–1270. Retrieved 16 July 2014.

- ↑ Marcus, Gary (24 November 2012). "Moral Machines". The New Yorker. Retrieved 30 July 2014.

- ↑ Winfield, Alan. "Artificial intelligence will not turn into a Frankenstein's monster". The Guardian. Retrieved 17 September 2014.

- ↑ Muehlhauser, Luke; Bostrom, Nick (2014). "Why we need friendly AI". Think. 13 (36): 41–47. doi:10.1017/S1477175613000316.

- ↑ Boyles, Robert James M.; Joaquin, Jeremiah Joven (2019). "Why Friendly AIs won't be that Friendly: A Friendly Reply to Muehlhauser and Bostrom". AI & Society. 35 (2): 505–507. doi:10.1007/s00146-019-00903-0. S2CID 198190745.

- ↑ Kornai, András. "Bounding the impact of AGI". Journal of Experimental & Theoretical Artificial Intelligence ahead-of-print (2014): 1-22. "...the essence of AGIs is their reasoning facilities, and it is the very logic of their being that will compel them to behave in a moral fashion... The real nightmare scenario (is one where) humans find it advantageous to strongly couple themselves to AGIs, with no guarantees against self-deception."

- ↑ Adam Keiper and Ari N. Schulman. "The Problem with 'Friendly' Artificial Intelligence". The New Atlantis. Retrieved 2012-01-16.

خواندن بیشتر[ویرایش]

- یودکوفسکی ، E. هوش مصنوعی به عنوان یک عامل مثبت و منفی در خطر جهانی . در خطرات فاجعه جهانی ، انتشارات دانشگاه آکسفورد ، 2008. درباره هوش مصنوعی از دیدگاه خطر وجودی بحث می کند . به طور خاص ، بخشهای 1-4 به تعریف AI Friendly در بخش 5 می پردازند. بخش 6 دو دسته از اشتباهات (فنی و فلسفی) را ارائه می دهد که هر دو منجر به ایجاد تصادفی هوش مصنوعی غیر دوستانه می شود. بخشهای 7-13 در مورد سایر موضوعات مرتبط بحث می کند.

- Omohundro، S. 2008 درایوهای AI اساسی در AGI-08 ظاهر شدند - مجموعه مقالات اولین کنفرانس هوش عمومی مصنوعی

- Mason، C. 2008 AI در سطح انسانی به هوش دلسوزانه نیاز دارد در کارگاه آموزشی AAAI 2008 در مورد Meta-Reasoning: Thinking About Thinking

پیوند به بیرون[ویرایش]

- مسائل اخلاقی در هوش مصنوعی پیشرفته توسط نیک بستروم

- Friendly AI چیست؟ — شرح مختصری از Friendly AI توسط موسسه تحقیقات هوش ماشین.

- ایجاد Friendly AI 1.0: تجزیه و تحلیل و طراحی معماری اهداف خیرخواهانه — نزدیک به کتاب از MIRI

- نقد رهنمودهای MIRI در مورد هوش مصنوعی دوستانه — توسط بیل هیبارد

- تفسیر رهنمودهای MIRI در مورد هوش مصنوعی دوستانه — توسط پیتر ووس.

- مشکل هوش مصنوعی "دوستانه" — در مورد انگیزه ها و عدم امکان FAI ؛ توسط آدام کیپر و آری ن. شولمن.

French

French Deutsch

Deutsch